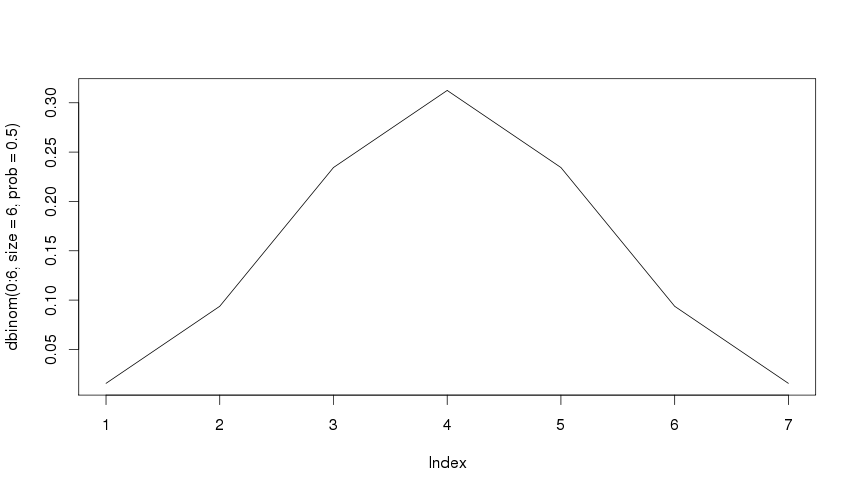

Kujutleme olukorda, kus jalgpallifänn väidab, et tema lemmikmeeskond võidab sellel hooajal üle poolte mängude, kuna meeskond on juba 20 mängust 11 võitnud.

11/20=0.55 e 55%

Kui kindlalt ikkagi fänn saab oma väites olla?

R keskkonnas aitab meid funktsioon prop.test()

> prop.test(11, 20, 0.5, alternative = 'greater')

1-sample proportions test with continuity correction

data: 11 out of 20, null probability 0.5

X-squared = 0.05, df = 1, p-value = 0.4115

alternative hypothesis: true p is greater than 0.5

95 percent confidence interval:

0.349615 1.000000

sample estimates:

p

0.55

Antud väljund näitab, et ega ikka väga kindel ei saa olla kuna p-value on palju suurem, kui 0.05 ja sellest tulenevalt ei ole mingit põhjust alternatiivset hüpoteesi, et tõenäosus on rohkem kui pool hooajal võita vastu võtta.

Algoritm väidab, et 95% tõenäosusega jääb vastus nende andmete puhul vahemiku 34% kuni 100%. Loomulikult ei ole me tõestanud, et fänni meeskond ei võiks siiski võita rohkem kui pooled korrad hooajal. Lihtsalt hetkel on vähe andmeid.

Kogume siis veel andmeid. Oletame, et hooaeg on pikk ja meeskond on juba mänginud 320 korda ja neist võitnud 176 korda. Paneme tähele, et suhtearv on sama

176/320=0.55 e 55% kuid andmeid on palju rohke.

> prop.test(176, 320, 0.5, alternative = 'greater')

1-sample proportions test with continuity correction

data: 176 out of 320, null probability 0.5

X-squared = 3.0031, df = 1, p-value = 0.04155

alternative hypothesis: true p is greater than 0.5

95 percent confidence interval:

0.502463 1.000000

sample estimates:

p

0.55

Nüüd on näha, et p-value on väiksem kui 0.05 ja meie fänn võib ikka päris julgelt endale vastu rinda taguda ja väita, et 95% tõenäosusega tema lemmikmeeskond võidab sellel hooajal rohkem kui pooled korrad (null probability 0.5)

Aga kas nende andmete põhjal saab väita, et lemmikmeeskond on eriti heas hoos ja võidab lausa 2/3 e lausa 0.66 66% juhtudel?

> prop.test(176, 320, 0.66, alternative = 'greater')

1-sample proportions test with continuity correction

data: 176 out of 320, null probability 0.66

X-squared = 16.7682, df = 1, p-value = 1

alternative hypothesis: true p is greater than 0.66

95 percent confidence interval:

0.502463 1.000000

sample estimates:

p

0.55

Nagu näha on p-value lausa oma maksimumväärtuses 1 ja meie fänn peab leppima teadmisega, et tema meeskond võidab rohkem kui pooltek kordadel. 2/3 teooriat ei toeta ka faktid 176 võitu 320-st.